苹果智能是苹果的新一代AI产品,不仅是面向消费者的特色功能;开发者也将能够利用最新技术。在周一的WWDC 2024上,苹果在主题演讲中宣布,开发者将能够将由苹果智能驱动的体验集成到他们自己的应用程序中。

苹果的SDK(软件开发工具包)已更新,引入了各种新的API和框架,让应用程序制作者可以仅凭几行代码即可集成Image Playground — 或genAI图片创建。苹果展示了Craft等应用如何利用此功能,通过允许用户添加AI图像来使用户文档更加直观。

AI驱动的写作工具还会自动在使用标准可编辑文本视图的任何应用程序中可用。因此,苹果演示了类似Bear Notes这样的应用程序将自动允许用户重写、校对和总结他们的笔记。

此外,苹果正在构建更多让开发者可以让Siri在应用程序中执行操作的方式。

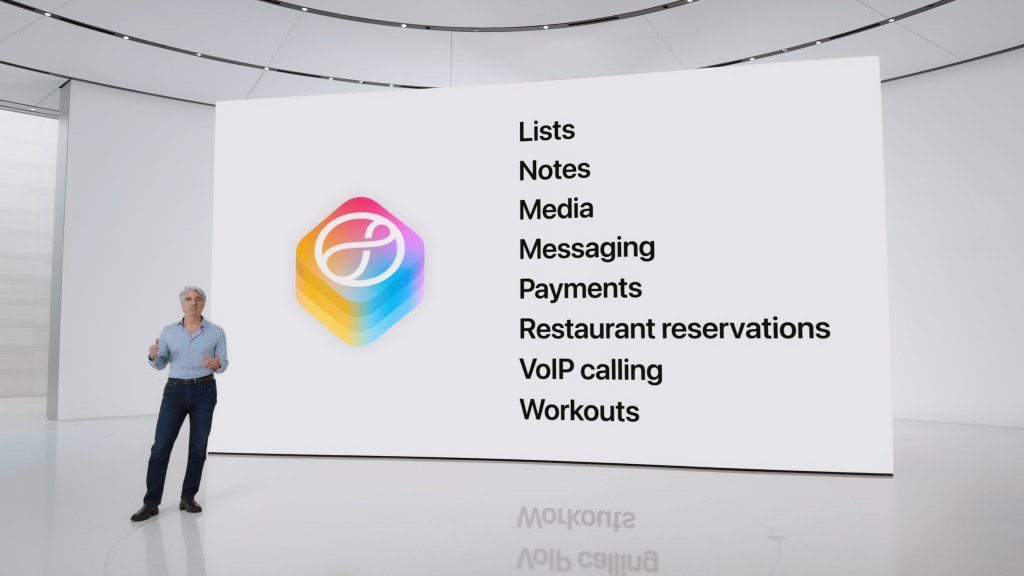

已经采用SiriKit的开发者将立即受益于许多Siri新功能的增强,无需额外工作,苹果表示。这包括列表、笔记、媒体、消息、支付、餐厅预订、VoIP呼叫和锻炼等领域。

苹果在其开发者主题演讲中表示,有两个新的Siri功能,开发者将能够在没有额外工作的情况下受益。首先,Siri将能够调用应用程序菜单中的任何项目。这意味着用户在演示文稿中可以说“显示我的演讲笔记”或者甚至更多对话式的内容,比如“我需要看一下我的演讲笔记”。

其次,Siri将能够访问页面上显示的任何文本,使用苹果的标准文本系统。这样,用户可以引用和执行屏幕上的文本。例如,如果您有一个提醒或笔记写着“祝祖父生日快乐”,您可以说“和他视频通话”来执行此提醒。

同时,苹果的App Intents框架也将获得对苹果智能的访问。

苹果正在定义新的意图,并使其适用于跨类别的开发者,首先以包括图书、浏览器、相机、文档阅读器、文件管理、日记、邮件、照片、演示文稿、电子表格、白板和文字处理器的子类别开始。

这些意图经过定义和测试,以便开发者更容易采用,苹果声称。

使用这些意图,照片编辑应用程序如Darkroom可以利用应用滤镜意图,使用户可以说“对我昨天拍的Ian照片应用一种电影效果”来执行操作。更多领域将在未来添加。

最初,用户将能够使用快捷方式应用程序进行开发,但随着时间的推移,Siri将具备呼叫支持领域中的应用程序意图的能力。

此外,苹果在其主题演讲中分享,适合现有SiriKit领域的应用程序将能够受益于Siri增强的对话功能,例如即使在口误或理解先前对话部分的引用时也能正确作出响应。

Siri还将能够使用新的Spotlight API从应用中搜索数据,该API使应用实体被包含在其索引中。这些实体是指苹果智能的语义索引中的照片、消息、文件、日历事件等。

另外,该公司还宣布了其自己的密码管理器应用、AI生成的Bitmoji和iPad的计算器应用。